Descomposición de Cholesky

La descomposición de Cholesky es una clase especial de descomposición matricial LU, del inglés Lower-Upper, que consiste en la factorización de una matriz en el producto de dos o más matrices.

En otras palabras, la descomposición de Cholesky consiste en igualar una matriz que contiene el mismo número de filas y columnas (matriz cuadrada) a una matriz con ceros por encima de la diagonal principal multiplicada por su matriz traspuesta con ceros por debajo de la diagonal principal.

La descomposición de LU, al contrario que Cholesky, puede aplicarse a varios tipos de matrices cuadradas.

Características de la descomposición de Cholesky

La descomposición de Cholesky consiste en:

- Una matriz cuadrada triangular superior: Matriz cuadrada que sólo tiene ceros debajo de la diagonal principal.

- Una matriz cuadrada triangular inferior: Matriz que sólo tiene ceros por encima de la diagonal principal.

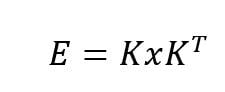

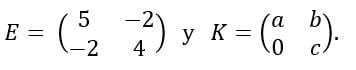

Matemáticamente, si existe una matriz simétrica definida positiva, E, entonces existe una matriz simétrica triangular inferior, K, de la misma dimensión que E, resultando en:

La matriz anterior figura como la matriz de Cholesky de E. Esta matriz actúa como la raíz cuadrada de la matriz E. Sabemos que el dominio de la raíz cuadrada, es:

{ X ∈ ℜ : x ≥ 0}

La cual está definida en todos los números reales no negativos. De la misma manera que la raíz cuadrada, la matriz de Cholesky solo existirá si la matriz está definida semi-positiva. Una matriz está definida semi-positiva cuando los principales menores tienen un determinante positivo o cero.

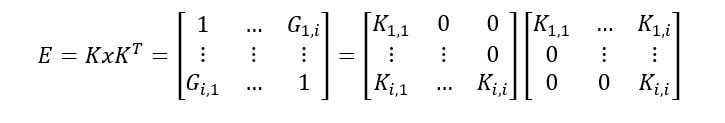

La descomposición de Cholesky de E es una matriz diagonal tal que:

Podemos ver que las matrices son cuadradas y contienen las características mencionadas; triángulo de ceros por encima de la diagonal principal en la primera matriz y triángulo de ceros por debajo de la diagonal principal en la matriz transformada.

Aplicaciones de la descomposición de Cholesky

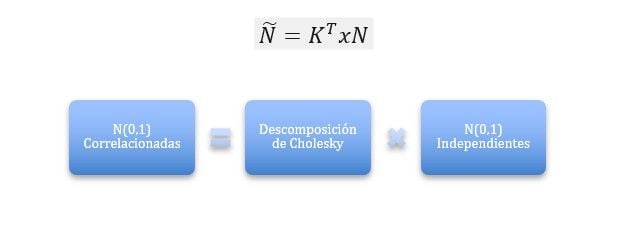

En finanzas se utiliza para transformar las realizaciones de variables normales independientes en variables normales correlacionadas según una matriz de correlaciones E.

Si N es un vector de normales (0,1) independientes, se cumple que Ñ es un vector de Normales (0,1) correlacionadas según E.

Ejemplo de la descomposición de Cholesky

Este es el ejemplo más sencillo que podemos encontrar de descomposición de Cholesky ya que las matrices tienen que ser cuadradas, en este caso, la matriz es (2×2). Dos filas por dos columnas. Además, cumple con las características de tener ceros por encima y por debajo de la diagonal principal. Esta matriz está definida semi-positiva porque los principales menores tienen un determinante positivo. Definimos:

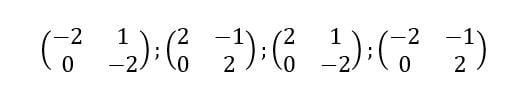

Resolviendo para: c2 = 4; b·c=-2; a2+b2 = 5; tenemos cuatro posibles matrices de Cholesky:

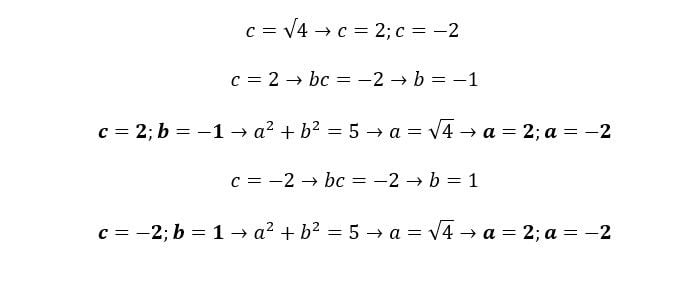

Por último calculamos para encontrar (a,b,c). Una vez los encontremos, tendremos las matrices de Cholesky. El cálculo es el siguiente:

Autores

Publicado por Paula Rodó el 13 mayo 2019.

Revisado por última vez el 13 mayo 2019.

Cómo citar este artículo

Rodó, P. (2019). Descomposición de Cholesky. Economipedia. https://economipedia.com/definiciones/descomposicion-de-cholesky.html

Sobre Economipedia

Este artículo forma parte de la enciclopedia de Economipedia, una plataforma de educación financiera que ayuda a millones de personas a entender la economía, aprender a invertir y mejorar sus finanzas personales. Fundada en 2012 por Andrés Sevilla Arias y desarrollada por más de 50 economistas y asesores financieros.

Todavía no hay comentarios

Hay 2 tipos de personas: las que leen y se van…y las que dejan huella 👇