R cuadrado ajustado (Coeficiente de determinación ajustado)

El R cuadrado ajustado (o coeficiente de determinación ajustado) se utiliza en la regresión múltiple para ver el grado de intensidad o efectividad que tienen las variables independientes en explicar la variable dependiente.

En palabras más simples, el R cuadrado ajustado nos dice qué porcentaje de variación de la variable dependiente es explicado colectivamente por todas las variables independientes.

El uso de este coeficiente se justifica en que a medida que añadimos variables a una regresión, el coeficiente de determinación sin ajustar tiende a aumentar. Incluso cuando la contribución marginal de cada una de las nuevas variables añadidas no tiene relevancia estadística.

Por lo tanto, al añadir variables al modelo, el coeficiente de determinación podría aumentar y podríamos pensar, de manera errónea, que el conjunto de variables elegido es capaz de explicar una mayor parte de la variación de la variable independiente. A este problema se le conoce comúnmente como “sobreestimación del modelo”.

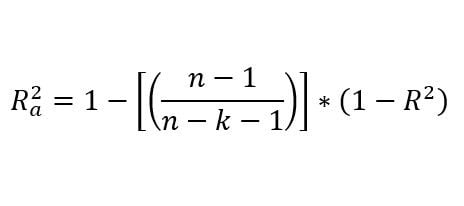

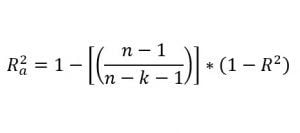

Fórmula del coeficiente de determinación ajustado

Para solucionar el problema descrito anteriormente, muchos investigadores sugieren ajustar el coeficiente determinación mediante la siguiente fórmula:

R2 a → R cuadrado ajustado o coeficiente de determinación ajustado

R2 → R cuadrado o coeficiente de determinación

n → Número de observaciones de la muestra

k → Número de variables independientes

Teniendo en cuenta que 1-R2 es un número constante y que n es mayor que k, a medida que añadimos variables al modelo, el cociente entre paréntesis se hace más grande. Consecuentemente. también el resultado de multiplicar este por 1-R2 . Con lo cual vemos que la fórmula está construida para ajustar y penalizar la inclusión de coeficientes en el modelo.

Además de la ventaja anterior, el ajuste empleado en la fórmula anterior, nos permite también comparar modelos con distinto número de variables independientes. De nuevo, la fórmula ajusta el número de variables entre un modelo y otro y nos permite realizar una comparación homogénea.

Volviendo la fórmula anterior, podemos deducir que el coeficiente de determinación ajustado será siempre igual o menor que el coeficiente de R2. Al contrario que el coeficiente de determinación que varía entre 0 y 1 el coeficiente de determinación ajustado podría ser negativo por 2 motivos:

- Cuanto más se aproxime k a n.

- Cuanto menor sea el coeficiente de determinación.

Autores

Publicado por Francisco Javier Marco Sanjuán el 7 noviembre 2018.

Revisado por última vez el 24 noviembre 2022.

Cómo citar este artículo

Javier Marco Sanjuán, F. (2018). R cuadrado ajustado (Coeficiente de determinación ajustado). Economipedia. https://economipedia.com/definiciones/r-cuadrado-ajustado-coeficiente-de-determinacion-ajustado.html

Sobre Economipedia

Este artículo forma parte de la enciclopedia de Economipedia, una plataforma de educación financiera que ayuda a millones de personas a entender la economía, aprender a invertir y mejorar sus finanzas personales. Fundada en 2012 por Andrés Sevilla Arias y desarrollada por más de 50 economistas y asesores financieros.

Todavía no hay comentarios

Hay 2 tipos de personas: las que leen y se van…y las que dejan huella 👇